音声AIの新たな時代が到来!

2025年2月26日、PerplexityはXで「Voice Mode」を発表しました。この新機能により、ユーザーは音声で質問し、AIがリアルタイムで音声回答。英語や日本語を含む複数言語に対応し、天気やニュースなど最新情報を瞬時に取得できます。

現在、iOSアプリで利用可能で、Android版も近日公開予定。本記事では、Voice Modeの特徴や使い方、他のAIとの違いについて、AIに詳しくない方でもわかりやすく解説します。

Perplexity Voice Modeの主な特徴

1. リアルタイム音声対話が可能に

ユーザーが音声で質問すると、Perplexityが即座に音声で回答します。例えば、「今日の天気は?」と尋ねると、最新の天気情報をリアルタイムで取得し、音声で答えてくれます。

2. 複数言語に対応し、日本語でもスムーズに会話

英語や日本語を含む複数の言語で利用可能です。X上では、「日本語でも正しく応答する」との報告もあり、今後さらなる対応言語の追加が期待されます。

3. 最新ニュースや情報を即座に取得

Perplexityの強みであるリアルタイム検索機能と連携し、最新のニュースや情報を音声で提供できます。例えば、「NVIDIAの決算ニュースを教えて」と尋ねると、直近のニュースを即座に読み上げてくれます。

4. iOSアプリで利用可能(Android版は近日公開)

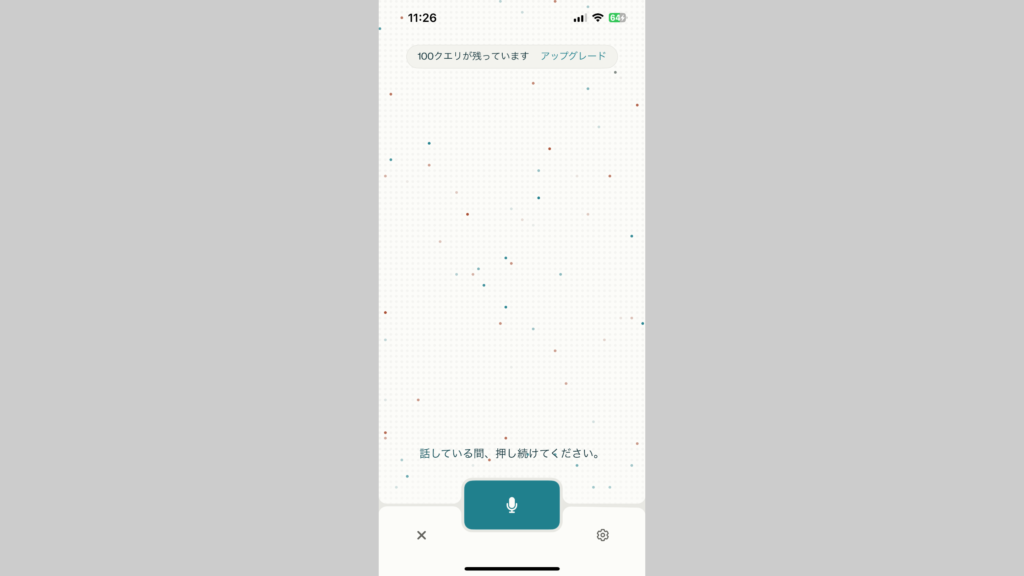

現在、iOSアプリで利用可能で、Android版も近日中にリリース予定です。今は無料で利用可能ですが、使用制限は現時点で未発表です。

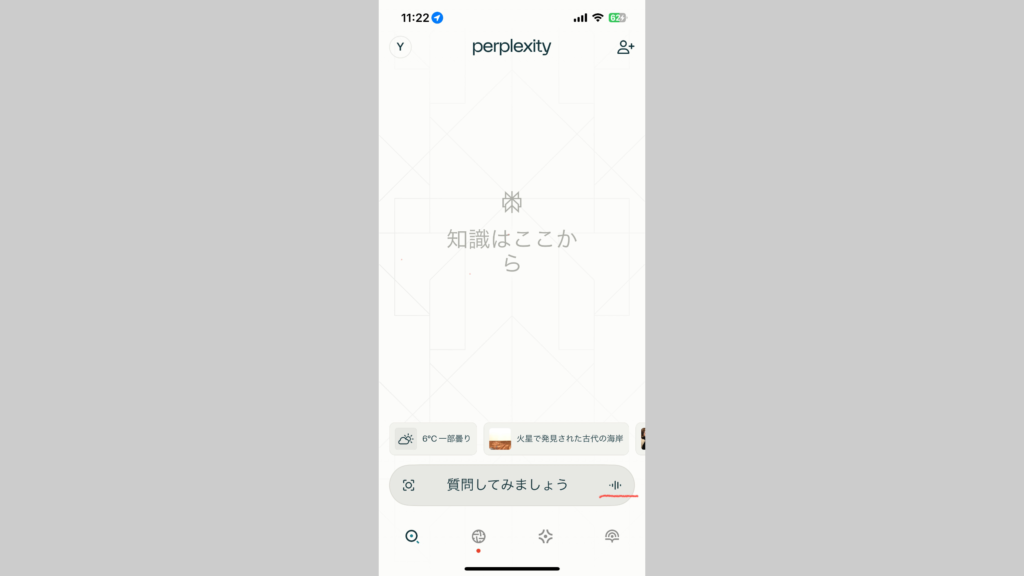

Perplexity Voice Modeの使い方(iPhone)

1. マイクアイコンをタップ(画面右下の青いボタン)

2. 質問を話しかける(例:「今日の東京の天気は?」「最新のテクノロジーニュースを教えて」など

3. AIが音声で即回答し、画面にもテキストが表示される

他の音声AIとの違い

Perplexityの「Voice Mode」は、リアルタイム音声対話 と 最新情報の即時取得 を組み合わせた独自の機能を持っています。他の主要なAIアシスタント(ChatGPT、Google Gemini 2.0)との違いを整理します。

ChatGPT(Advanced Voice Mode)との比較

- OpenAIは2025年2月26日時点で「Advanced Voice Mode」を提供(OpenAI公式サイト)。

- ChatGPTの音声モードは、会話形式の対話に特化。リアルタイム検索機能は制限あり、最新情報を取得するにはプラスプラン(月20ドル)への加入が必要(OpenAI公式ブログ、2025年2月25日)。

- Perplexity Voice Modeは無料でリアルタイム検索が可能。例えば「最新ニュースは?」と尋ねると、検索結果を基に即座に音声で回答する。

Google Gemini 2.0との比較

- 2025年2月26日に「エシカルAIモード」を導入し、テキスト・画像・音声のマルチモーダル対応 を提供(Google公式ブログ)。

- Gemini 2.0は無料プランとProプラン(月20ドル)で利用可能。ただし、リアルタイム音声対話に特化しているという情報は確認されていない(Google Cloud公式サイト)。

- Perplexity Voice Modeは、検索エンジンと連携し 最新情報を取得しながら音声で回答する という明確な違いがある。

Perplexity Voice Modeは、リアルタイム情報を取得しながら音声で回答する点 で他のAIとは異なります。特に、最新ニュースやトレンド情報を音声で手軽に取得したいユーザーにとって、独自の強みを持つ ことがわかります。

まとめ|リアルタイム音声AIの未来が広がる!

Perplexityの新機能「Voice Mode」は、リアルタイム音声対話と最新情報の即時取得 を可能にする画期的なアップデートです。

最新ニュースや調べ物を手軽に音声で聞ける ため、情報収集のスタイルが大きく変わるかもしれません。今後のアップデートにも注目です。

コメント